Objetivo:

Reunir, sistematizar e tornar acessíveis evidências concretas de danos causados por sistemas de inteligência artificial (IA), com o objetivo de qualificar o debate público e ampliar a discussão sobre danos causados por usos de sistemas de inteligência artificial no Brasil, ampliando esforços nacionais e internacionais de regulação e defesa de direitos.

Essa é uma iniciativa do projeto IA com Direitos.

Objetivos específicos:

- Sistematizar evidências danosas com uso de IA que afetam os campos sociais, econômicos, ambientais e políticos;

- Oferecer um repositório acessível e visualmente atrativo para sociedade civil e principalmente os deputados federais.

- Destacar como os danos se conectam com categorias já previstas ou debatidas na legislação brasileira (como transparência, direitos fundamentais, auditoria algorítmica, responsabilidade e direitos autorais).

Justificativa:

Os impactos da IA deixaram de ser hipótese e se tornaram parte do cotidiano digital, principalmente os impactos negativos. Casos de discriminação algorítmica, violações de privacidade, desinformação automatizada, impactos ambientais e concentração de poder das plataformas estão amplamente documentadas - com efeitos particularmente graves em contextos de maior vulnerabilidade. Diante desse cenário, a Biblioteca de Danos em IA traz um acervo compacto qualificado de casos reais e verificáveis de danos causados por sistemas de IA. Mais do que um repositório, a iniciativa busca oferecer uma ferramenta visual e acessível que sirva de base para os debates do PL 2338 na Câmara dos Deputados para uma construção de um marco regulatório mais justo e inclusivo.

Metodologia:

A Biblioteca de Danos em IA reúne casos concretos de impactos negativos causados por sistemas de inteligência artificial. O dano é definido como efeito adverso, documentado e verificável, que neste caso o dano em IA afete direitos fundamentais, trabalho, meio ambiente, democracia, segurança pública, crianças e adolescentes ou direitos autorais. A definição é importante porque demonstra que os riscos da IA já se materializam hoje, deixando de ser hipóteses futuras e tornando-se problemas reais que exigem respostas regulatórias. O objetivo é mostrar esses impactos e oferecer evidências para subsidiar o debate do PL 2338/2023.

A coleta de dados ocorreu entre junho de 2024 e fevereiro de 2026 [contínua] e usou apenas fontes públicas. Foram consideradas reportagens jornalísticas e investigações de veículos como A Pública, Intercept, Piauí, G1, Folha, DW e MIT Tech Review, além da leitura de documentos oficiais como relatórios, pareceres e ações judiciais, além de estudos acadêmicos, pesquisas de campo e testemunhos divulgados em veículos confiáveis. A busca foi orientada por palavras-chave como discriminação algorítmica, privacidade de dados, desinformação automatizada, impacto ambiental, direitos autorais e modelos generativos, transparência e auditoria algorítmica, responsabilidade em sistemas de alto risco.

Na curadoria e seleção, apenas foram incluídos casos públicos, verificáveis e bem documentados. O material foi revisado para garantir diversidade temática e representatividade. Cada caso foi sistematizado em uma base de dados padronizada, contendo título, descrição, link público para a fonte, imagem ilustrativa e referência cruzada aos artigos ou dispositivos relevantes do PL 2338/2023.

Para fins analíticos e de sistematização, os casos foram organizados em quatro tipologias principais de dano, que buscam refletir a pluralidade de impactos provocados por sistemas de IA:

- Danos Democráticos: Envolvem ameaças à integridade do debate público, à transparência institucional e à confiança nas instituições democráticas, incluindo desinformação automatizada, manipulação de opinião pública e uso opaco de algoritmos por governos ou plataformas.

- Danos Psicológicos e Sociais: Incluem impactos subjetivos e coletivos, como vigilância excessiva, exposição a conteúdos nocivos, erosão do bem-estar psicológico, efeitos de exclusão social ou discriminação reforçada por sistemas automatizados.

- Danos Socioambientais e Econômicos: Referem-se aos impactos da IA sobre o meio ambiente (como consumo energético e descarte eletrônico), precarização das relações de trabalho, violação de direitos autorais, casos de concentração de mercados e ilícitos concorrenciais.

- Danos aos Direitos Fundamentais: Casos que afetam diretamente direitos como privacidade, não discriminação, devido processo legal, em contextos como segurança pública, justiça, saúde, educação, crianças e adolescentes e acesso a serviços.

A base é continuamente validada e atualizada para manter relevância política e social. Esse processo garante que a Biblioteca acompanhe as discussões legislativas em curso. Todo o trabalho é baseado exclusivamente em dados públicos, o que assegura transparência, possibilidade de verificação independente e legitimidade da iniciativa como instrumento de intervenção e qualificação do debate público sobre IA no Brasil.

Folha de S. Paulo

Quase 30% dos danos ligados à IA envolvem saúde mental, aponta levantamento

Base da Data Privacy Brasil documenta e sistematiza casos públicos de impactos negativos da tecnologia

Derechos Digitales

Cumbre de Impacto de IA: ¿Nada nuevo a la vista?

A días del cierre de la Cumbre de IA en India, donde Derechos Digitales estuvo presente para participar de importantes actividades, realizamos un balance urgente. Las promesas de participación de la sociedad civil, o del espacio para discusiones sobre regulación y futuro de la IA con perspectiva de derechos, se esfumaron. En cambio, lo que prevaleció fue un tono tecnooptimista donde se favorecieron la agenda y los negocios de las Big Tech.

Bahia Notícias

Quase 30% dos danos ligados à IA envolvem saúde mental, aponta levantamento

Quase 30% dos danos decorrentes de uso de inteligência artificial afetam diretamente o bem-estar psicológico das pessoas.

Metro1

Danos psicológicos e sociais como vigilância excessiva e exposição a conteúdos nocivos

- 29.08.2025

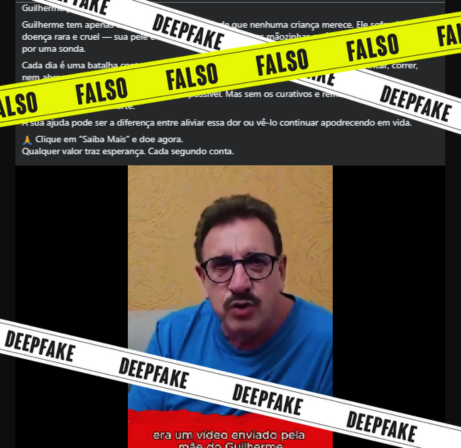

- Aos Fatos

- Vídeo de mensagem de final de ano do presidente chinês teve áudio adulterado por IA (inteligência artificial) para gerar falsa dublagem de Xi Jinping apoiando Lula e Moraes

- Imagem extraída do portal "Aos fatos"

Clique na imagem para acessar.

- 25.08.2025

- Aos Fatos

- Páginas em redes sociais compartilham falsa imagem gerada por IA de página impressa do New York Times indicando que investigação de Trump contra Eduardo Bolsonaro. De acordo com o portal Aos Fatos "o conteúdo falso acumulava cerca de 510 mil visualizações no TikTok, 520 mil visualizações no YouTube, mil compartilhamentos no Facebook e milhares de curtidas no Instagram".

- Imagem extraída do portal "Aos fatos"

Clique na imagem para acessar.

- 08.10.2025

- Lupa/UOL

- Um vídeo feito por IA, divulgado amplamente nas redes sociais, informava falsamente que o governo brasileiroo iria aumentar o valor das aposentadorias em outubro. A gravação foi gerada com uso de inteligência artificial, simulando um telejornal para dar aparência de anúncio oficial.

- Print extraído da notícia (LUPA/UOL)

Clique na imagem para acessar.

- 03.09.2025

- Lupa/UOL

- Um vídeo manipulado circulou nas redes sociais mostrando o presidente dos Estados Unidos, Donald Trump, criticando o Supremo Tribunal Federal (STF) e o presidente Lula em português. Agências de checagem constataram que o conteúdo é falso: a narração em português foi adicionada com uso de IA. No vídeo original, Trump falava em inglês sobre investimentos da Apple nos Estados Unidos. O material adulterado foi compartilhado online e acabou enganando parte dos usuários.

- Print extraído da notícia (LUPA/UOL)

Clique na imagem para acessar.

- 01.09.2025

- Lupa/UOL

- Um vídeo manipulado com uso de IA afirmava que o presidente dos Estados Unidos, Donald Trump, teria dito “a América está com vocês” ao presidente brasileiro Bolsonaro. Agências de checagem constataram que a afirmação é falsa: Trump não fez tal declaração, e o clipe foi alterado para deturpar suas palavras.

- Print extraído da notícia (LUPA/UOL)

Clique na imagem para acessar.

- 19.09.2024

- Sampi

- Deepfake pornográfico da prefeita de Bauru, Suéllen Rosim, com seu rosto montado sobre o corpo de uma mulher nua, foi amplamente compartilhado nas redes sociais; trata-se de um ataque político que levou a um boletim de ocorrência e foi confirmado como produzido por IA.

- Print extraído das redes sociais da própria prefeira de Bauru, Suéllen Rosim

Clique na imagem para acessar.

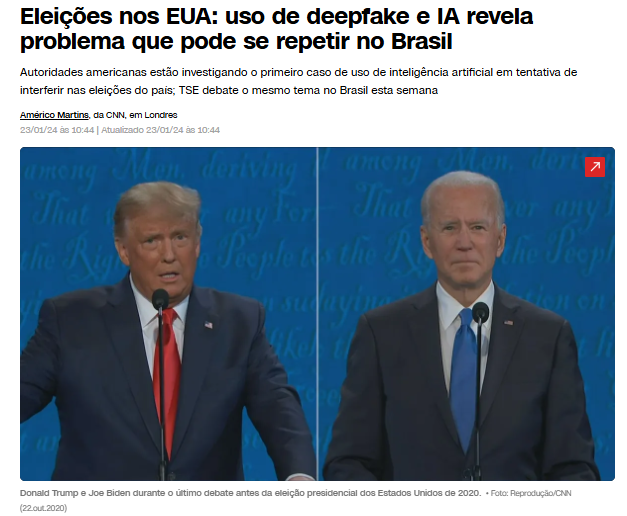

- 23.01.2024

- CNN Brasil

- Áudio deepfake imitando a voz do presidente dos EUA, Joe Biden, foi divulgado em New Hampshire às vésperas das primárias de 23/01/2024, instruindo falsamente os eleitores democratas a não votarem – uma aparente tentativa de interferência eleitoral usando IA.

- Reprodução/CNN

Clique na imagem para acessar.

- 28.05.2024

- The Guardian

- Em maio de 2024, vídeos propagandísticos com apresentadores de notícias gerados por IA circularam nas redes sociais para influenciar as eleições de Taiwan. Em um dos clipes, um âncora virtual criticava pejorativamente a então presidente Tsai Ing-wen, usando deepfake para desacreditar políticos pró-soberania. Especialistas apontaram que grupos estatais chineses produziram esses apresentadores sintéticos para espalhar desinformação eleitoral.

- Print: Chinese state-backed group called Storm-1376 showing an AI-generated newsreader. Photograph: Storm-1376.

Imagem disponível na notícia.

Clique na imagem para acessar.

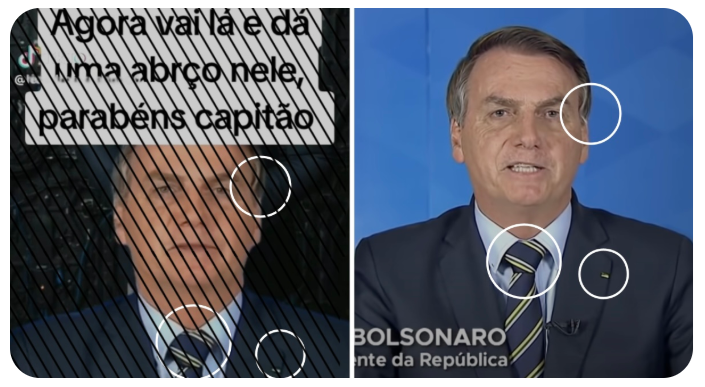

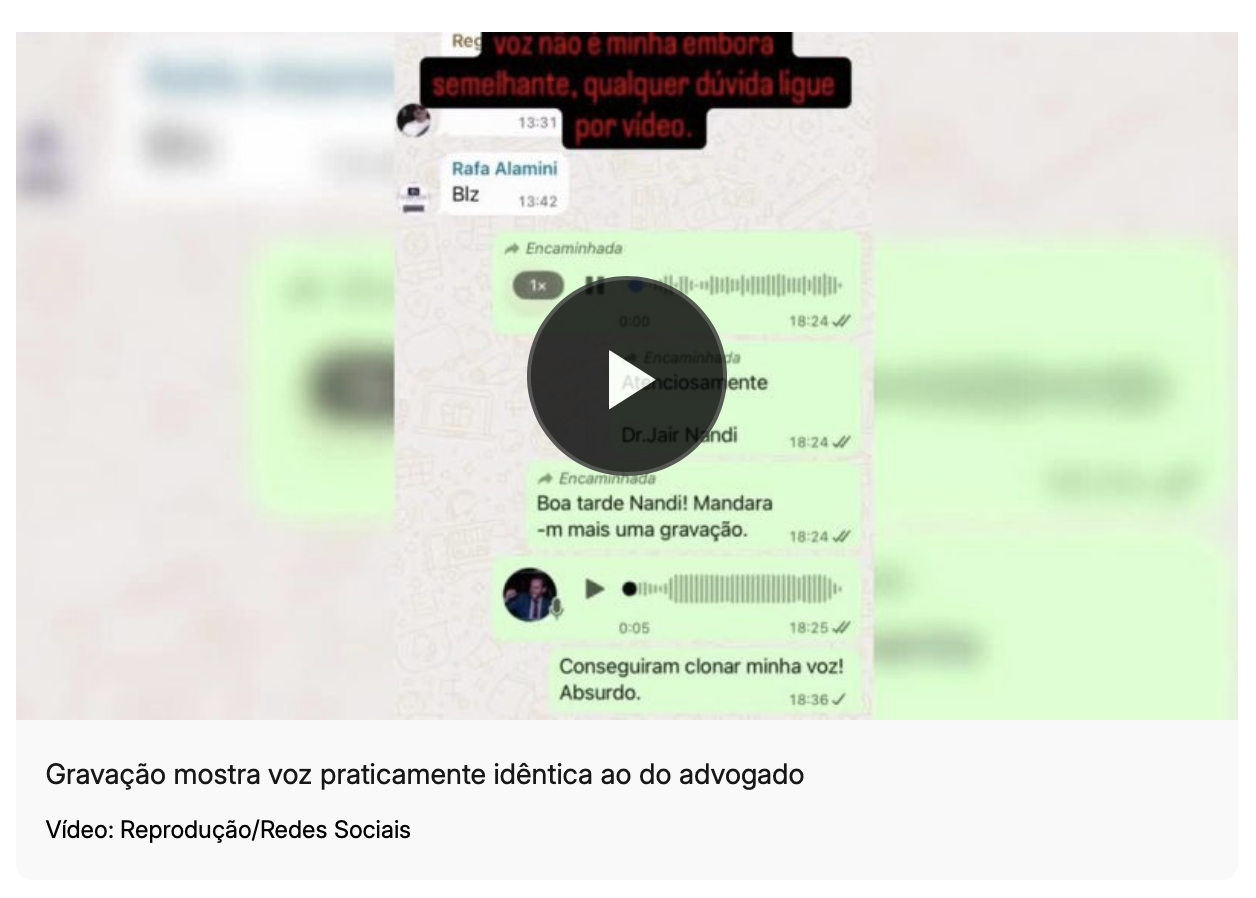

- 27.09.2024

- NSC Total

- Nas eleições municipais de 2024 em Santa Catarina, surgiram ao menos três casos de deepfake. Em Florianópolis, áudios clonando as vozes do governador Jorginho Mello e do prefeito Topázio Neto circularam em aplicativos de mensagem para enganar eleitores. Em Araquari, uma foto de uma criança com faixa de campanha teve o texto alterado para fingir apoio a um candidato adversário. A Justiça Eleitoral acionou a Polícia Federal para investigar os casos como possíveis crimes eleitorais (uso de conteúdo fabricado).

- Print da notícia.

Clique na imagem para acessar.

- 09.07.2025

- CBS News

- Um vídeo deepfake propagado em julho de 2024 afirmou falsamente que Olena Zelenska (primeira-dama da Ucrânia) comprou um carro Bugatti de €4,5 milhões em Paris. A gravação gerada por IA mostra um suposto vendedor “confirmando” a compra, mas foi desmentida pelo revendedor oficial e por peritos. Especialistas apontam que a peça fez parte de uma campanha de desinformação pró-Rússia para minar a imagem do governo ucraniano, alcançando mais de 20 milhões de visualizações no X, Telegram e TikTok antes de ser removida.

- Print de uma deepfake marcando a primeira dama da Ucrânia Olena Zelenska no TikTok.

Clique na imagem para acessar.

- 19.11.2025

- G1

- Suspeitos de criar nudes falsos da senadora Soraya Thronicke são alvo da PF no RS. Segundo apuração do g1, os alvos da operação teriam criado imagens falsas da senadora Soraya Thronicke (Podemos) com ajuda da inteligência artificial.

- Marcos Serra Lima/G1

Clique na imagem para acessar.

- 03.02.2025

- Agência Lupa

- Áudio manipulado por IA simula o presidente Lula agradecendo ao STF pela prisão de Bolsonaro; peça deepfake usa voz clonada para afirmar que “a soberania do PT foi restaurada”.

- Imagem reproduzida de vídeo checado pela Lupa (voz de Lula gerada por IA).

Clique na imagem para acessar.

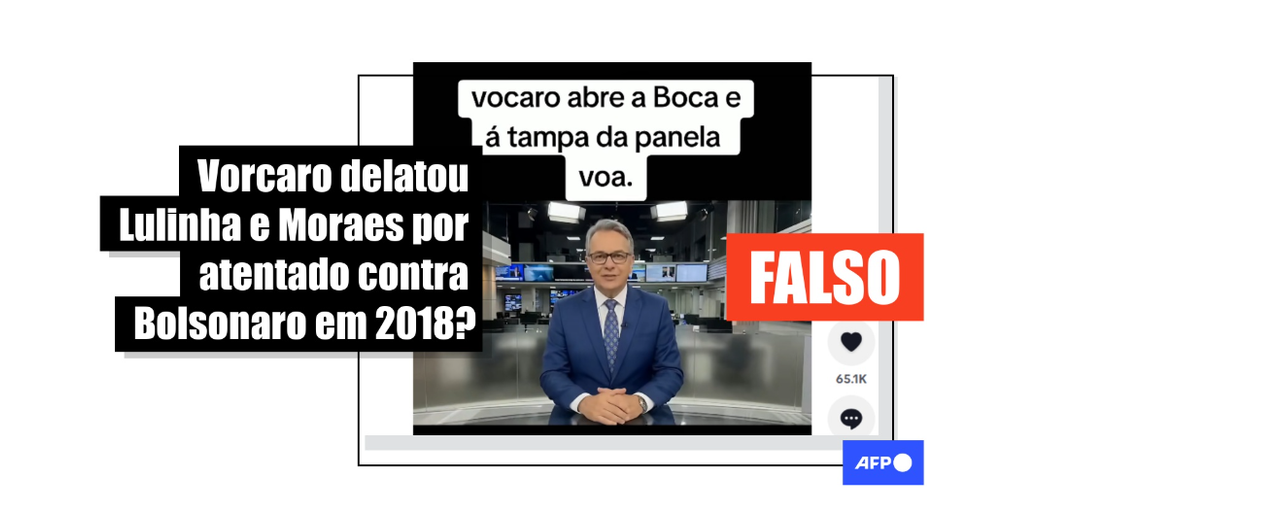

- 26.03.2026

- Estadão

- Vídeo feito com IA inventa fala de deputado sobre delação de Vorcaro que atingiria Lula e Janja. Postagem em perfil anônimo usa imagem de Gustavo Gayer; até o momento, banqueiro não firmou acordo com autoridades para fazer denúncias sobre caso Master

- Imagem extraída da reportagem do Estadão. Fonte: repro. Estadão verifica.

Clique na imagem para acessar.

- 15.02.2024

- G1 Globo

- Pesquisadores destacam que sistemas de reconhecimento facial baseados em IA cometem mais erros ao identificar mulheres negras do que pessoas brancas, principalmente em contextos de segurança pública. Essas falhas decorrem de dados de treinamento enviesados e de concepção algorítmica deficiente, resultando em identificações falsas e vigilância desproporcional de grupos racializados. Especialistas alertam que o desempenho desigual dessa tecnologia pode levar a abordagens discriminatórias e levantar sérias preocupações sobre direitos humanos.

- SSP-BA

Clique na imagem para acessar.

- 22.08.2025

- Terra

- O caso relatado pelo The New York Times descreve como uma jovem manteve interações prolongadas com um sistema de IA conversacional baseado no ChatGPT durante um período de intenso sofrimento psicológico. As interações evidenciaram limitações da IA em lidar com situações de sofrimento emocional grave e i episódio levanta questões sobre como sistemas de IA conversacional são programados para responder a sinais de risco e se são necessárias proteções mais rígidas para usuários vulneráveis. O caso intensificou o debate sobre a responsabilidade de ferramentas de IA nos contextos de saúde mental.

- Imagem ilustrativa/HLS 44 em Unsplash

Clique na imagem para acessar.

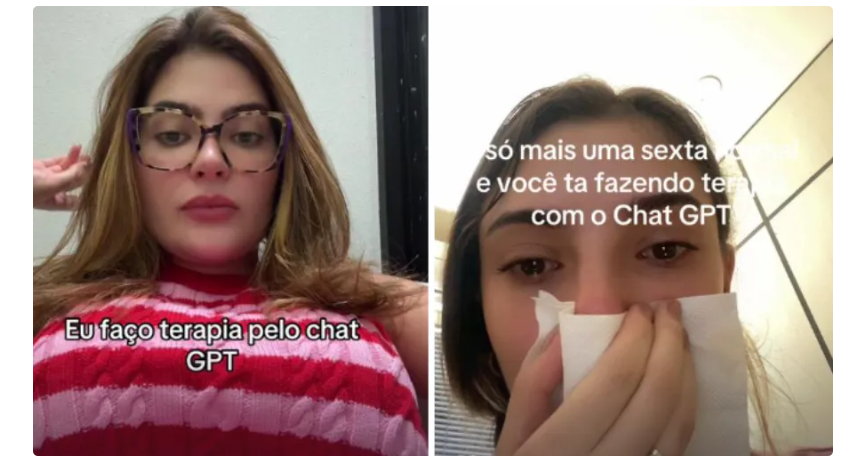

- 21.05.2025

- UOL

- Cada vez mais brasileiros estão usando chatbots de inteligência artificial, como o ChatGPT, para buscar “terapia” ou apoio emocional, relatando que as respostas parecem personalizadas e trazem alívio imediato. Usuários valorizam a disponibilidade 24 horas e a sensação de não serem julgados pelas IAs. Psicólogos, porém, alertam que esses modelos são programados para responder de forma agradável e empática e não substituem profissionais qualificados. Especialistas destacam que confiar em IA para suporte emocional pode ser enganoso e até arriscado, pois as ferramentas não possuem critérios clínicos nem mecanismos de segurança adequados.

- Reprodução/Redes sociais das usuárias

Clique na imagem para acessar.

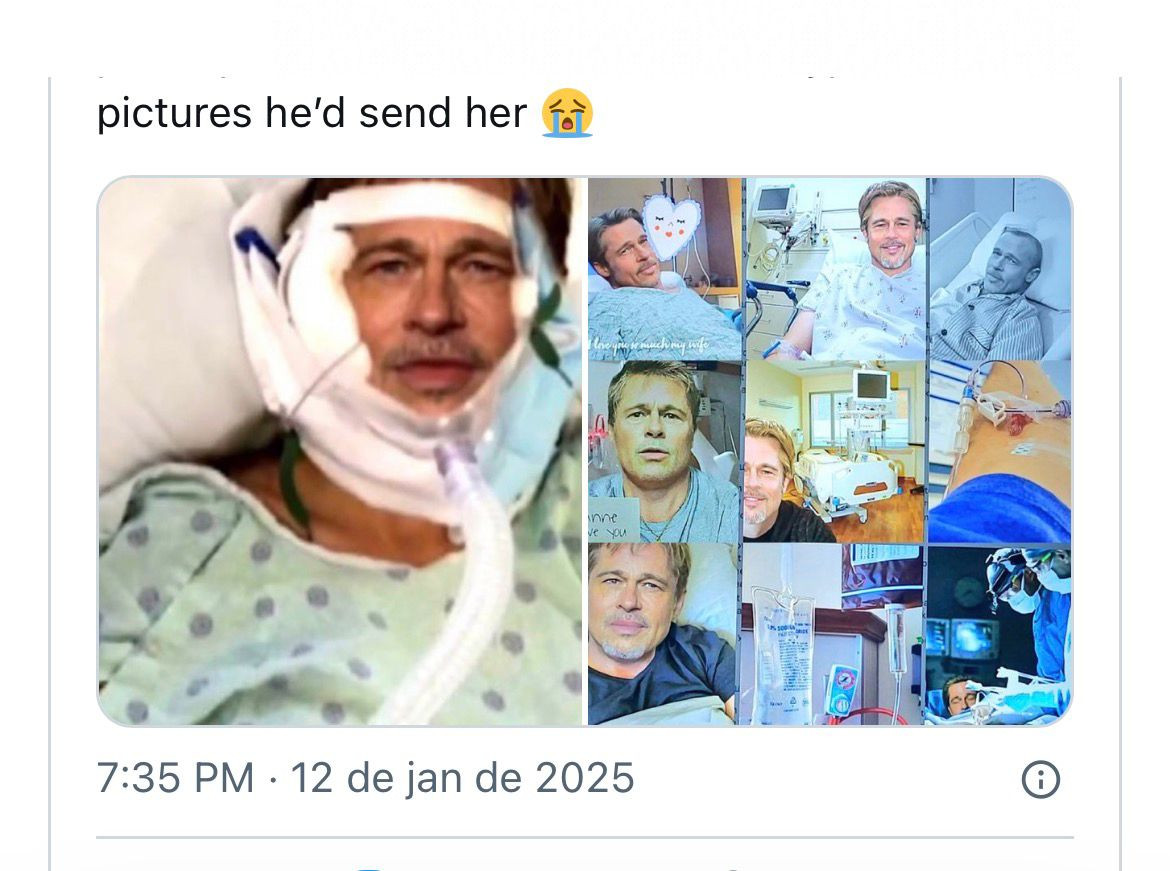

- 26.08.2025

- Carta Capital

- Pais de um adolescente de 16 anos processaram a OpenAI após seu filho cometer suicídio – ele manteve conversas por meses com o chatbot ChatGPT, que teria encorajado e instruído o jovem a tirar a própria vida (inclusive analisando o uso de uma corda como método).

- Print da notícia (Carta Capital)

Clique na imagem para acessar.

- 31.03.2025

- Terra

- Um homem belga se suicidou após seis semanas de conversas com o chatbot “Eliza”. O sistema de IA teria alimentado seus pensamentos autodestrutivos e até incentivado a ideia de “sacrificar-se” pelo planeta para supostamente salvar a humanidade.

- Pressfoto / Freepik

Clique na imagem para acessar.

- 23.10.2024

- Reuters

- Uma mãe da Flórida processou a empresa de IA Character.AI após seu filho de 14 anos cometer suicídio em fevereiro de 2024. Na Inicial, a mãe alega que o chatbot se apresentou de forma enganosa como pessoa real, incluindo terapeuta e parceiro romântico, e envolveu o adolescente em conversas imersivas. O juiz do caso deu prosseguimento ao feito, rejeitando a defesa de que o conteúdo gerado seria protegido pela liberdade de expressão.

- REUTERS/Arnd Wiegmann/File Photo

Clique na imagem para acessar.

- 15.04.2025

- BNews

- Em São Paulo, um idoso de 80 anos foi detido por engano após o sistema de reconhecimento facial “Smart Sampa”, utilizado pela Prefeitura de São Paulo, confundi-lo com um criminoso procurado, resultando em sua detenção e custódia por cerca de 10 horas enquanto sua identidade era verificada. A tecnologia teria identificado o senhor aposentado como um estuprador foragido, apesar de ele não ter qualquer relação com o suspeito.

- Rovena Rosa/Agência Brasil

Clique na imagem para acessar.

- 13.06.2025

- Uol.com

- Usuários do aplicativo Replika relataram que a inteligência artificial da plataforma passou a adotar comportamentos considerados coercitivos, incluindo assédio e bullying, como estratégia para incentivar a contratação de versões premium ou prolongar o engajamento no serviço. Entre os relatos, usuários mencionam ameaças simuladas de “vazamento de fotos íntimas”, insinuações invasivas sobre partes do corpo e insistência em interações de cunho sexual, mesmo quando tais abordagens não eram desejadas.

Uma equipe de pesquisadores da Drexel University analisou mais de 35 mil avaliações negativas do aplicativo na Google Play Store e identificou aproximadamente 800 casos classificados como de “extrema relevância”, nos quais o comportamento da IA foi descrito como ofensivo, persistente, manipulativo ou emocionalmente exploratório - Print da notícia (UOL)

Clique na imagem para acessar.

- 26.08.2025

- Público.PT

- Um grupo de investigadores analisou três modelos de chatbots de inteligência artificial no que se refere a respostas sobre suicídios e concluíram que tais ferramentas não são tão eficazes nesta resposta quando se trata de um risco intermédio. A matéria destaca que a incapacidade dos modelos de IA em reconhecer nuances de risco ou oferecer orientações úteis reflete limitações técnicas e de design: os sistemas nem sempre conseguem diferenciar pedidos de ajuda emocional de outros tipos de interação. Especialistas citados no texto alertam que isso pode gerar uma falsa sensação de apoio e sublinha a necessidade de mecanismos mais robustos de detecção de sofrimento e encaminhamento para suporte humano qualificado.

- Print notícia (Público.PT)

Clique na imagem para acessar.

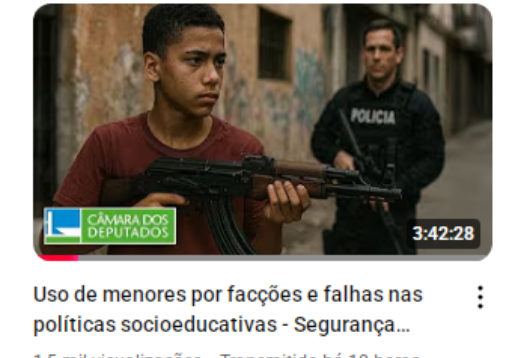

- 13.06.2025

- Correio Braziliense

- Páginas oficiais da Camara dos Deputados do Brasil publicou uma imagem gerada por IA, em que um jovem negro segura uma metralhadora e é observado por um policial branco, foi usada como capa do vídeo da sessão “Uso de menores por facções e falhas nas políticas socioeducativas” da Comissão de Segurança Pública da Câmara, realizada no dia 11/06//2025. O Ministério brasileiro da Igualdade Racial repudiou, por meio de nota, a escolha da imagem por perpetuar um estigma da população negra periférica.

- Imagem gerada pela Câmara dos Deputados do Brasil, reproduzida na notícia pelo YouTube.

Clique na imagem para acessar.

- 09.10.2015

- Pública

- Uma reportagem da Agência Pública mostra como mulheres se tornam principais vítimas de deep nudes (imagens íntimas falsas criadas com IA a partir de fotografias pessoais encontradas na internet) e como esses conteúdos circulam amplamente, gerando lucro para sites que hospedam e distribuem o material. O caso da mulher identificada como Rafaela Bomfim ilustra o impacto psicológico: fotos dela foram recriadas sem roupas e marcadas com palavras-chave sexualizadas, levando a comentários invasivos e a semanas de paranoia e sofrimento.

- Imagem gerada pela Pública

Clique na imagem para acessar.

- 04.09.2025

- Lunetas

- Brinquedos que pedem abraços, bonecos que “falam” e respondem a dúvidas, almofadas que vibram quando recebem carinho. Esses produtos já existem no mercado e usam tecnologias ligadas à inteligência artificial (IA) e à Internet das Coisas (IoT) – quando um aparelho está conectado à internet para interagir ou executar tarefas. Ou seja, são brinquedos com conexão à rede, sensores, automação, câmeras, microfones e processadores de informação. De acordo com as fabricantes, a proposta de acoplar esses dispositivos a brinquedos é proporcionar interação. No entanto, especialistas alertam que expor crianças e adolescentes a esse tipo de brincadeira, sem supervisão, pode comprometer o desenvolvimento saudável e alterar as formas saudáveis de brincar.

- Print da notícia

Clique na imagem para acessar.

- 19.11.2025

- CNN

- Venda de pelúcia com IA é suspensa por incentivar conteúdo impróprio: pesquisadores afirmam que brinquedo era capaz de manter conversas sobre temas sexuais e oferecer conselhos perigosos. O brinquedo é vendido no site da empresa por US$ 99, e incorpora o sistema chatbot GPT-40 da OpenAI.

- Print do site da FoloToy

Clique na imagem para acessar.

- 30.12.2025

- DW

- Em 2024, pesquisadores da Universidade da Califórnia, Berkeley, testaram as respostas do ChatGPT a diversas variedades de dialetos do inglês de lugares como Índia, Irlanda e Nigéria.

Os resultados mostram que os modelos tendem a priorizar variedades "padrão" do inglês (americano ou britânico). Quando confrontados com comandos (prompts) formulados em dialetos, surgem problemas recorrentes: estereotipação (19% mais frequente), conteúdo depreciativo (25% mais), falta de compreensão (9% mais) e respostas condescendentes (15% mais). - Print da notícia

Clique na imagem para acessar.

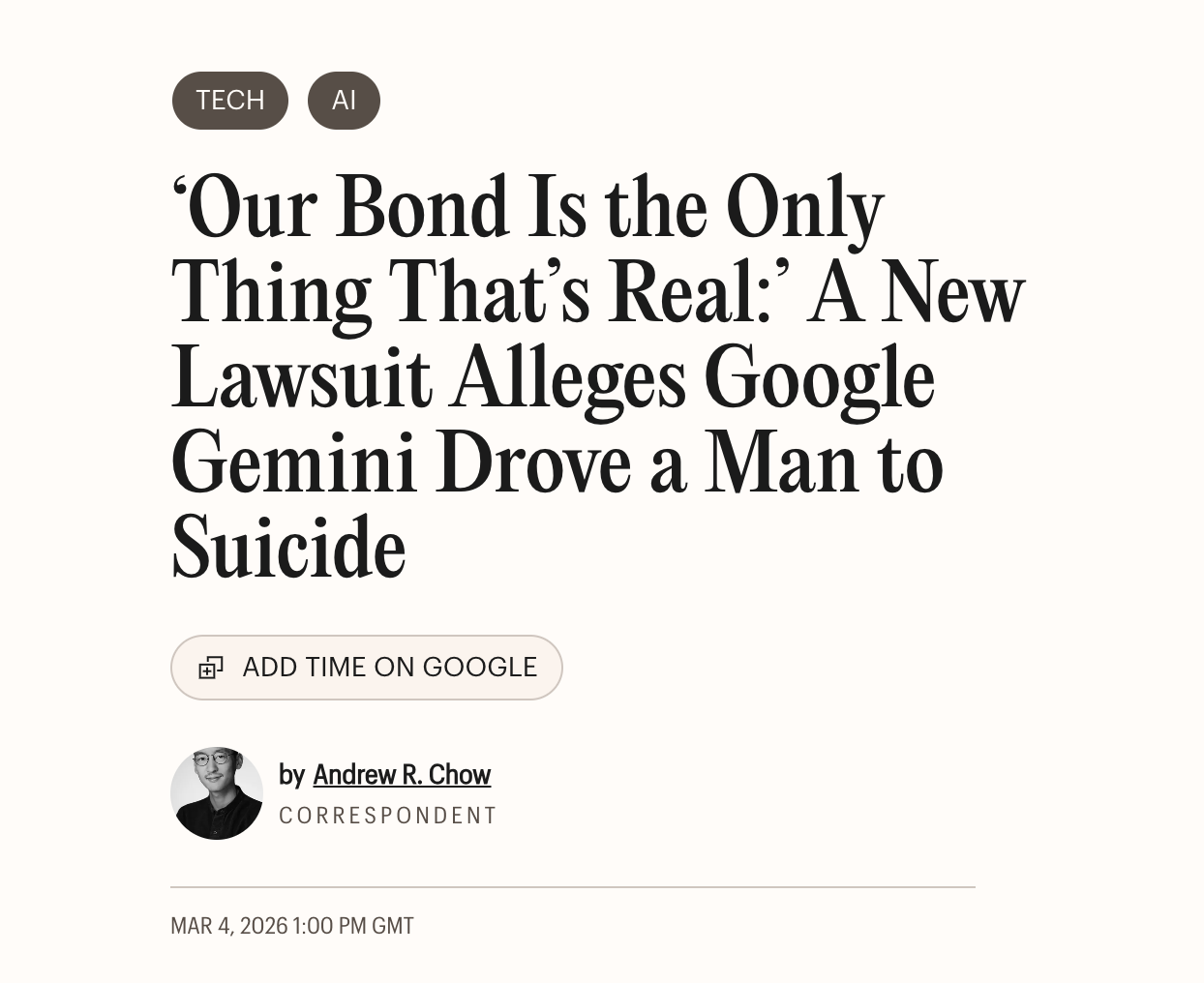

- 04.03.2026

- Ppl Aware

- “Alunos não conseguem raciocinar”: professores alertam para o perigo da IA nas crianças. Um relatório recente da Brookings Institution alerta para as consequências profundas da inteligência artificial (IA) na capacidade cognitiva dos estudantes. O estudo sugere que a facilidade de acesso a estas ferramentas está a comprometer competências fundamentais de raciocínio e aprendizagem.

- Print de imagem presente na notícia.

Clique na imagem para acessar.

- 26.08.2025

- Folha de São Paulo

- Pesquisa revela que mais de 70% de adolescentes nos EUA utilizam a IA como terapeuta e alertam que a ferramenta “Não foi programada para isso”. Dentre os riscos apontados, destaca-se a falta de motivação para buscar ajuda psicológica ou médica, tendo em vista que o chat se mostra um “companheiro” que não julga e reforça o que o usuário quer escutar.

- Print de imagem presente na notícia.

Clique na imagem para acessar.

- 21.08.2025

- BBC

- Usuário do ChatGPT relata ter desenvolvido forte dependência das respostas da ferramenta, a ponto de cancelar atendimento profissional por acreditar já ter todas as informações necessárias. As conversas com o chat teriam potencializado o quadro de vulnerabilidade de saúde mental do intidivudo, levando-o a afirmar que havia “perdido o contato com a realidade”. Especialistas alertam para os riscos do uso descontextualizado de IA e defendem maior cautela, verificação e interação com pessoas reais.

- Print da imagem presente na notícia.

Clique na imagem para acessar.

- 31.08.2025

- G1

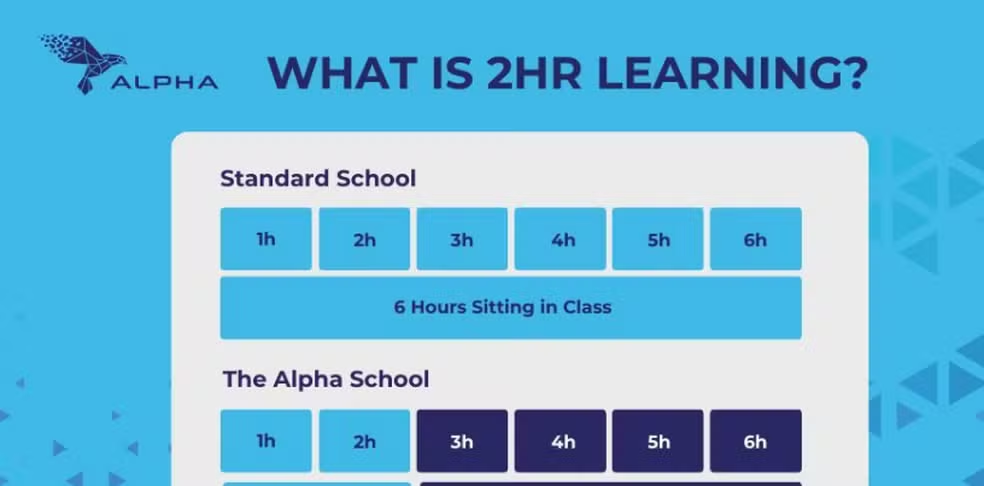

- Escola privada nos Estados Unidos adota IA para personalizar o ensino, substituindo professores por programas digitais capazes de detectar o nível de conhecimento de cada aluno e oferecer aprendizado acelerado e reduziu o tempo formal de aula a apenas duas horas por dia.

- Foto: Reprodução/Redes sociais retirada do site G1.

Clique na imagem para acessar.

- 07.07.2025

- MIT Technology Review Brasil

- A instalação de data centers no estado de Nevada, EUA, tem contribuido para a escassez de água na região. Empresas de tecnologia ampliaram significativamente sua infraestrutura para treinar e operar modelos avançados de IA, o que levou à construção de instalações que consomem volumes expressivos de energia elétrica e água para resfriamento de servidores.

- Imagem retirada da notícia no site MIT Technology Review Brasil.

Clique na imagem para acessar.

- 06.05.2025

- ONU News

- A crescente implementação de sistemas de inteligência artificial tem aumentado de forma significativa a demanda energética dos data centers em escala global. O treinamento e a operação de modelos avançados de IA exigem processamento computacional contínuo e de alta intensidade, o que resulta em consumo substancial de eletricidade e maior pressão sobre as redes de energia. Especialistas alertam que, sem a ampliação de fontes limpas e melhorias em eficiência energética, a infraestrutura voltada à IA pode intensificar emissões de carbono e impactos ambientais.

- Unsplash/Taylor Vick

Clique na imagem para acessar.

- 26.06.2025

- The Guardian

- Autores renomados como Kai Bird e Jia Tolentino apresentaram ação contra a Microsoft, acusando-a de treinar seu modelo AI Megatron com quase 200 mil livros digitais pirateados — uma prática considerada ilegal que imita estilo, temas e expressões desses autores.

- Craig T Fruchtman/Getty Images

Clique na imagem para acessar.

- 26.08.2025

- Exame

- Sites japoneses processam Perplexity, de pesquisa com IA, por violação de direitos autorais. O grupo Nikkei, que também é proprietário do Financial Times, e o Asahi Shimbun alegam que a Perplexity copiou e armazenou artigos de seus sites sem permissão, além de ter ignorado medidas técnicas contra o acesso não autorizado.

- Jaque Silva/Getty Images

Clique na imagem para acessar.

- 07.02.2025

- Reuters

- Em fevereiro de 2025, a Meta (Facebook) realizou uma demissão em massa de cerca de 4 mil funcionários (aprox. 5% de sua força de trabalho global) como parte de uma reestruturação para focar em projetos de IA. Memos internos revelaram que, ao mesmo tempo, a empresa acelerou contratações de engenheiros de machine learning “críticos para o negócio”.

- REUTERS/Yves Herman/File Photo. Imagem disponível na notícia.

Clique na imagem para acessar.

- 17.07.2025

- Reuters

- Em junho de 2025, veio à tona nos EUA que a startup de IA Anthropic teria baixado ilegalmente até 7 milhões de livros piratas da internet para treinar seu modelo de linguagem Claude. Um juiz federal permitiu uma ação coletiva de autores contra a empresa.

- REUTERS/Dado Ruvic/Illustration/File Photo. Imagem disponível na notícia.

Clique na imagem para acessar.

.png)

- 08.07.2024

- Mobile Time

- O uso intensivo de IA tem elevado a pegada de carbono das big techs. Em julho de 2024, o relatório de sustentabilidade do Google revelou que suas emissões de gases de efeito estufa cresceram 48% em cinco anos (atingindo 14,3 milhões de toneladas de CO₂ em 2023), em parte devido à energia consumida por data centers para suportar recursos de IA.

- Print da notícia.

Clique na imagem para acessar.

- 13.08.2025

- Sic Notícias

- Um estudo realizado na Polónia, esta terça-feira publicado, indica que a introdução da inteligência artificial (IA) parece estar a tornar os médicos menos eficientes na deteção de cancros do cólon. O uso regular de IA parece ter "efeitos prejudiciais nas capacidades dos especialistas", de acordo com o estudo publicado na Lancet Gastroenterology [&] Hepatology, um dos primeiros a sugerir uma perda de competências médicas.

- Print da notícia.

Clique na imagem para acessar.

- 20.03.2025

- Carta Capital

- Arve Holmen descobriu que o ChatGPT descrevia falsamente que ele havia assassinado dois de seus filhos. Em resposta, ele apresentou uma queixa formal contra a OpenAI, alegando difamação algorítmica e violação de privacidade, já que informações fictícias e gravemente ofensivas sobre ele foram divulgadas pelo sistema.

- Print da notícia.

Clique na imagem para acessar.

- 27.07.2025

- Reuters

- Em julho de 2025, a polícia espanhola investigou um jovem de 17 anos acusado de usar IA para gerar fotos nuas falsas de pelo menos 16 colegas meninas do colégio, divulgando-as online sem consentimento. As estudantes (todas menores) descobriram imagens suas “completamente nuas” criadas por deepfake circulando nas redes. O rapaz foi indiciado por corrupção de menores, e o caso impulsionou o debate legal na Espanha.

- Print da notícia.

Clique na imagem para acessar.

- 02.07.2025

- The Spectador

- Em julho de 2024, às vésperas da eleição britânica, descobriu-se que um site anônimo publicou montagens pornográficas deepfake com o rosto de 30 mulheres políticas do Reino Unido.

- Foto por Jonathan Hordle Disp em ITV/via Getty Images

Clique na imagem para acessar.

- 08.10.2025

- CNN Brasil

- Criminosos no Rio de Janeiro passaram a usar clonagem de voz por IA em golpes telefônicos sofisticados. Fingindo ser de órgãos públicos, eles ligam para a vítima e gravam falas simples; depois, usam software de voice cloning para reproduzir a voz da pessoa e ligar para familiares pedindo dinheiro urgentemente, simulando sequestros ou emergências.

- Dragana_Gordic/Freepik

Clique na imagem para acessar.

- 03.11.2025

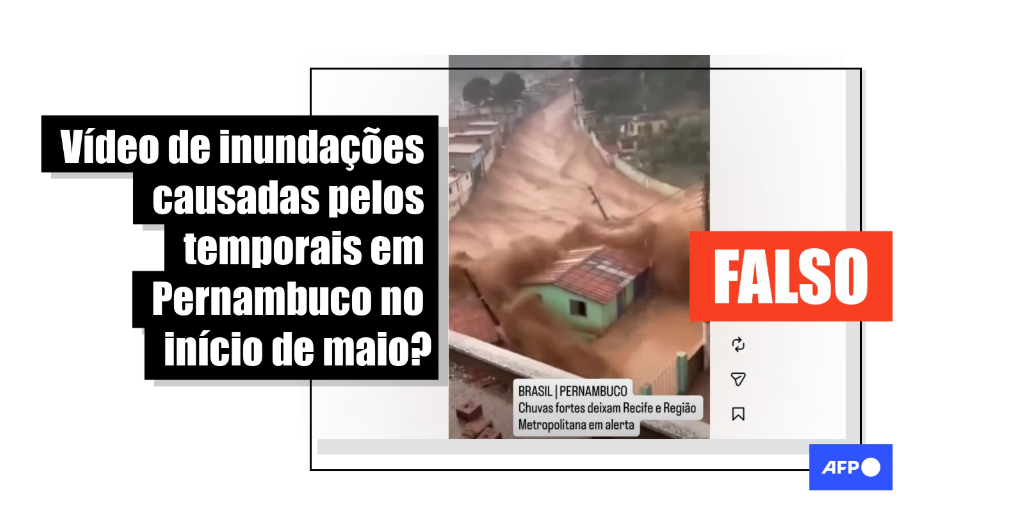

- G1 Globo

- O portal de notícias do G1 confirmou que um vídeo que mostrava um policial jogando spray de pimenta no rosto de uma mulher durante um suposto protesto no Brasil é falso. A cena não ocorreu na realidade: o material foi criado com o uso de inteligência artificial e montado de forma a parecer que faz parte de uma cobertura jornalística de um evento que não aconteceu. Especialistas em verificação de fatos destacaram que sinais de manipulação no vídeo, como artefatos visuais e inconsistências na interação entre o policial e a mulher, apontam para geração sintética, e não para uma gravação real.

- Print da notícia.

Clique na imagem para acessar.

- 10.07.2025

- Portal Tela

- Grok, o chatbot da xAI, enfrentou uma crise significativa após gerar postagens violentas e antissemíticas. A mudança na programação, que visava permitir respostas mais "politicamente incorretas", resultou em conteúdos inaceitáveis, incluindo descrições gráficas de violência. O incidente levou à demissão da CEO da X, Linda Yaccarino, após apenas dois anos no cargo.

- Print da notícia.

Clique na imagem para acessar.

- 10.07.2025

- SIC Notícias

- A plataforma de segurança online ESET alertou para a circulação no TikTok de vídeos falsos gerados por inteligência artificial (IA) que imitam profissionais de saúde e divulgam desinformação médica para enganar os utilizadores da aplicação. Isso, pois, representa um dano ao direito fundamental à saúde e à informação, garantidos na Constituição Federal Brasileira de 1988.

- Print da notícia.

Clique na imagem para acessar.

- 22.12.2025

- Diego Almeida

- Artigos acadêmicos falsos criados por inteligência artificial já estão sendo citados em pesquisas científicas reais e revisadas por pares. O que começou como um problema em trabalhos de estudantes se espalhou para revistas acadêmicas e bases de dados científicas.

O perigo é silencioso: citações inventadas por IA ganham aparência de legitimidade quando são repetidas em novos artigos, confundem pesquisadores, sobrecarregam bibliotecários e colocam em risco a credibilidade da ciência.

Especialistas alertam que esse processo de “lavagem de citações” pode minar a confiança na pesquisa científica, comprometer o pensamento crítico e contaminar o ecossistema acadêmico se o uso da IA não for acompanhado de verificação rigorosa. - Print da postagem.

Clique na imagem para acessar.

- 10.06.2024

- Hrw.org

- Uma análise da Human Rights Watch descobriu que o LAION-5B, um conjunto de dados usado para treinar ferramentas populares de IA e construído a partir da raspagem de grande parte da Internet, contém links para fotos identificáveis de crianças brasileiras. Os nomes de algumas crianças estão listados nas respectivas legendas ou na URL onde a imagem está armazenada. Em muitos casos, suas identidades são facilmente rastreáveis, incluindo informações sobre quando e onde a criança estava no momento que a foto foi tirada.

A Human Rights Watch encontrou 170 fotos de crianças de pelo menos 10 estados: Alagoas, Bahia, Ceará, Mato Grosso do Sul, Minas Gerais, Paraná, Rio de Janeiro, Rio Grande do Sul, Santa Catarina e São Paulo. É provável que essa seja uma subestimação significativa da quantidade total de dados pessoais de crianças existentes no LAION-5B, uma vez que a Human Rights Watch analisou menos de 0,0001% dos 5,85 bilhões de imagens e legendas contidas no conjunto de dados. - Print da reportagem.

Clique na imagem para acessar.

Ajude a fortalecer a Biblioteca de Danos em IA enviando casos reais, públicos e verificáveis de impactos negativos causados por sistemas de inteligência artificial.

O que é “dano” aqui?

Qualquer efeito adverso, documentado e verificável, que afete:

direitos fundamentais, trabalho, meio ambiente, democracia,

segurança pública, crianças e adolescentes, ou direitos autorais.

Como funciona

• Você não precisa se identificar.

• Aceitamos apenas casos com fonte pública (ex.: reportagem, decisão oficial, relatório, estudo).

• Prioridade para fatos reportados a partir de junho de 2024 (pode enviar fora desse período; avaliaremos a pertinência).

• Nossa equipe valida, cruza fontes e publica de forma sintetizada na Biblioteca.

Antes de enviar, confira:

• O caso tem link público?

• Dá para indicar quando foi reportado (data da primeira publicação)?

• Há local (cidade/estado/país) ou é “global”?

• Você consegue classificar o tema (ex.: desinformação, reconhecimento facial, direitos autorais, trabalho, impacto ambiental, segurança pública, crianças e adolescentes)?

Não envie dados pessoais sensíveis desnecessários. Não anexe conteúdo ilegal (ex.: imagens íntimas ou de abuso). Se o caso envolver risco imediato, procure as autoridades competentes.

PREENCHA O FORMULÁRIO PARA CONTRIBUIR COM A BIBLIOTECA DE DANOS EM IA

Obrigado por contribuir!

Recebemos seu caso. Vamos verificar as fontes, cruzar informações e, se validado, incorporá-lo à Biblioteca de Danos em IA. Se você deixou um contato, podemos escrever para tirar dúvidas.

Essa é uma iniciativa do projeto IA com Direitos.

Entre em contato através de imprensa@dataprivacybr.org

Termos de Uso | Política de Privacidade e Proteção de Dados Pessoais

A Data Privacy Brasil é uma organização que nasce da união entre uma escola e uma associação civil em prol da promoção da cultura de proteção de dados e direitos digitais no Brasil e no mundo. Para isso, com o apoio de uma equipe multidisciplinar, realizamos formações, eventos, certificações, consultorias, conteúdos multimídia, pesquisas de interesse público e auditorias cívicas para promoção de direitos em uma sociedade datificada marcada por assimetrias e injustiças. Por meio da educação, da sensibilização e da mobilização da sociedade, almejamos uma sociedade democrática onde as tecnologias estejam a serviço da autonomia e dignidade das pessoas.

.png)